La inteligencia artificial se ha convertido en una herramienta omnipresente, pero considero que su uso indiscriminado está generando más problemas de los que parece. Delegar sin entender puede tener un coste alto en aprendizaje, criterio y autonomía.

Dependencia creciente y pérdida de criterio en el uso de la IA en educación

Cada vez es más común acudir a la inteligencia artificial como primera opción ante cualquier tarea, desde responder una pregunta simple o hacer una operación a escribir un texto o resolver un problema técnico. Esta inmediatez genera una falsa sensación de eficiencia, pero en realidad está erosionando la capacidad de análisis propio.

Cuando todo se delega, el criterio se debilita. Si la IA deja de ser una herramienta para convertirse en un sustituto del pensamiento, esto tiene consecuencias claras: menor capacidad de cuestionar resultados, dificultad para detectar errores y una dependencia progresiva que limita la autonomía intelectual.

El problema no es usar IA, sino dejar de pensar en el proceso. A largo plazo, esta práctica convierte a los usuarios en ejecutores pasivos en lugar de agentes críticos. En entornos educativos y profesionales, esto se traduce en una pérdida de calidad en la toma de decisiones.

Saber cuándo no usar la IA es tan importante como saber usarla. Sin ese equilibrio, el usuario deja de aprender y empieza simplemente a reproducir. Por esta razón he querido recoger aquí algunas advertencias y consejos de uso.

Resultados sin revisión: el riesgo invisible

Uno de los errores más frecuentes es asumir que el resultado generado por la IA es correcto por defecto. Esta confianza automática elimina un paso fundamental: la validación.

La IA puede producir respuestas plausibles pero incorrectas, sesgadas o incompletas. Sin revisión, estos errores pasan desapercibidos y se integran como si fueran válidos. Este fenómeno es especialmente peligroso en contextos académicos o profesionales, donde la precisión es clave y donde corremos el riesgo de pasar esos sesgos a nuestros estudiantes son ser conscientes.

La rapidez con la que se obtiene una respuesta y en ocasiones la cantidad abrumadora de información hace que muchas veces no se cuestione su calidad. Sin embargo, la IA no entiende el contenido, solo predice patrones. Por eso, confiar ciegamente en sus resultados implica asumir riesgos innecesarios.

La revisión no solo corrige errores, también fortalece el aprendizaje. Cuando este paso se omite, se pierde la oportunidad de entender el problema y sus matices. El resultado es una ilusión de conocimiento que no se sostiene en la práctica.

Automatizar sin entender: memorizar sin comprender

Usar la IA para tareas que no se dominan es equivalente a aprender matemáticas memorizando fórmulas sin entender su lógica interna. Puede funcionar en el corto plazo, pero falla cuando el contexto cambia.

La comprensión es lo que permite adaptar el conocimiento, no la repetición. Cuando se utiliza la IA sin entender el proceso, el usuario pierde la capacidad de formular buenas preguntas. Y sin buenas preguntas, la calidad de las respuestas disminuye.

Este es uno de los límites más importantes del uso de la IA en educación: depende directamente del nivel de quien la utiliza. Automatizar sin conocimiento previo crea una dependencia frágil. En lugar de ampliar capacidades, las reduce.

Por ejemplo, en programación, copiar código sin entenderlo impide depurarlo o adaptarlo. En el ámbito de la escritura, genera textos coherentes pero vacíos de intención real. La IA potencia a quien ya sabe, pero limita a quien no comprende. Por eso, el aprendizaje previo sigue siendo indispensable.

Uso superficial vs. uso estratégico de la IA

No todos los usos de la IA son iguales. Existe una diferencia clave entre usarla de forma superficial y hacerlo estratégicamente.

El uso superficial busca respuestas rápidas sin contexto ni profundidad. El uso estratégico, en cambio, integra la IA como apoyo dentro de un proceso consciente. Esto implica revisar, ajustar, cuestionar y complementar (habilidades más cercanas al orden superior en la taxonomía de Bloom).

La IA puede ser una herramienta poderosa para explorar ideas, optimizar tareas repetitivas o acelerar procesos complejos, pero siempre bajo supervisión. El problema surge cuando se convierte en el centro del proceso en lugar de un complemento.

Un uso estratégico requiere intención: saber qué se busca, por qué y cómo se va a validar. También implica reconocer sus límites. La IA no reemplaza la experiencia, ni el criterio, ni la responsabilidad. Bien utilizada, amplifica capacidades. Mal utilizada, las sustituye. La diferencia está en el nivel de implicación del usuario.

Cuándo usar la IA: de sustitución a aumento (modelo ISAR)

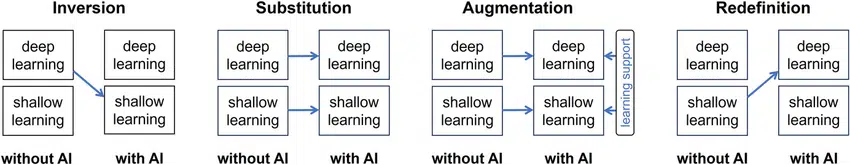

Un uso adecuado de la IA no es sustituir el pensamiento, sino aumentarlo. El modelo ISAR (Inversión, Sustitución, Aumento, Redefinición), propuesto por Bauer, Greiff, Graesser y Scheiter (2025), ayuda a entenderlo: copiar-pegar sin reflexión es inversión; usarla como Wikipedia o chatbot es sustitución; emplearla como tutor es aumento; y rediseñar tareas con ella es redefinición.

El objetivo debería ser moverse hacia aumento y redefinición, evitando efectos de inversión como la sobredependencia y la reducción del compromiso cognitivo descritos por estos autores.

La IA funciona mejor cuando hay un “volante humano”: como KITT frente a KARR, la tecnología potencia, pero alguien debe dirigir. Sin criterio, la autonomía total conduce a errores difíciles de detectar. Por eso, la IA debe entrar en fases donde aporte velocidad o perspectiva, pero no en aquellas donde se construye la comprensión.

Consejos finales: cuándo usar y cuándo evitar la IA

Usa la IA cuando:

- Necesites acelerar tareas repetitivas

- Busques inspiración o nuevas perspectivas (y vigila porque la IA no inventa, reproduce de lo que hay)

- Tengas conocimiento suficiente para validar resultados

- Quieras estructurar ideas o mejorar claridad

Evita usar la IA cuando:

- Realizar tareas cuando estés aprendiendo algo desde cero

- No puedas verificar la información

- Necesites desarrollar pensamiento crítico

- La tarea requiera criterio experto o responsabilidad directa

Sobre el autor

Iñaki Ibargoyen Vergara (@IIV_Docente) es docente, amante de los juegos y una persona muy activa, siempre en busca de innovar y participar en nuevos proyectos educativos. Actualmente es Embajador de Letcraft Educación.

Es cofundador de Docentes Gamificando, un proyecto centrado en divulgar esta metodología y fomentar la compartición de recursos entre docentes. También es cocreador de Tichit, una aplicación de gestión de centros educativos y gamificaciones.

Además, investiga la aplicabilidad de la Realidad Virtual en el aula a través del proyecto VRStationForEducation, buscando colaboración con entidades para el desarrollo de Serious Games. Junto a su hermano, ha iniciado la web Readlongs para incentivar la lectura mediante soporte auditivo. Asimismo, colabora en el desarrollo de UX y UI de MyClassGame.

Finalmente, imparte cursos sobre gamificación y crea tutoriales de aplicaciones utilizables en la docencia. Puedes visitar su página aquí: terraalia.com